Système de reconnaissance des émotions faciales en milieu éducatif

Contexte et objectif :

Ce projet vise à développer une application intelligente capable de reconnaître les émotions humaines à partir de l’analyse des expressions faciales. Dans le contexte de l’enseignement, cette technologie permet d’adapter les contenus pédagogiques en fonction des émotions détectées chez les apprenants, améliorant ainsi l’engagement et la rétention.

Problématique :

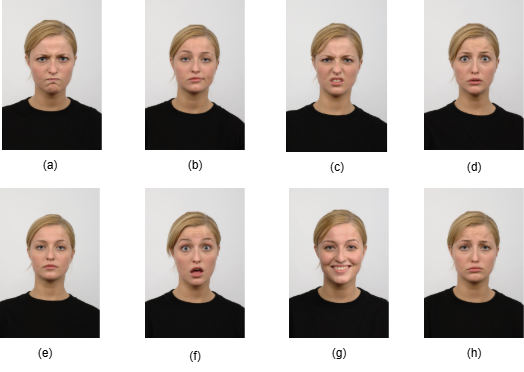

L’objectif principal est de concevoir un système basé sur l’intelligence artificielle pour interpréter les émotions à l’aide d’images faciales. Pour cela, la base de données RaFD, qui contient des images haute résolution de visages exprimant huit émotions fondamentales, a été utilisée.

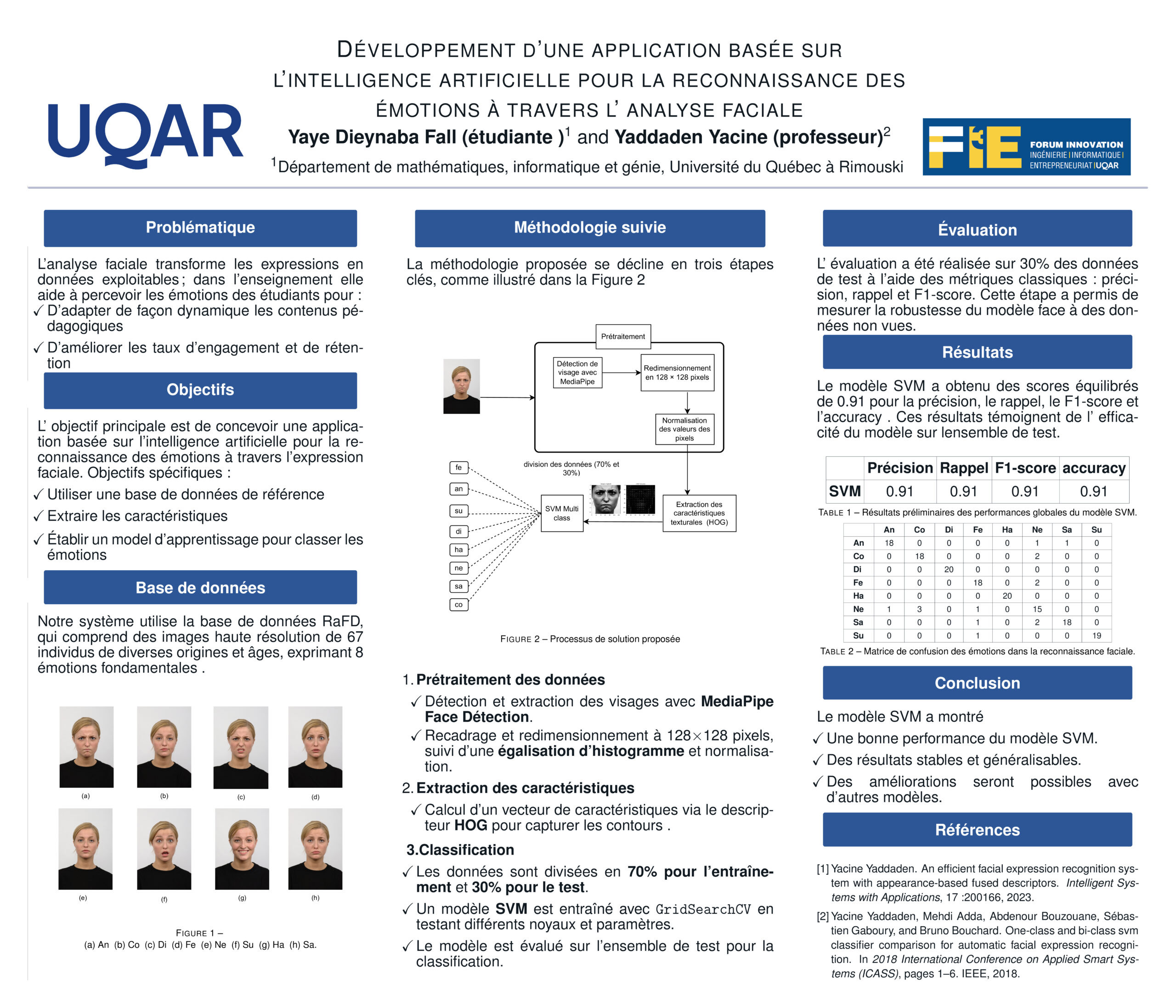

Méthodologie :

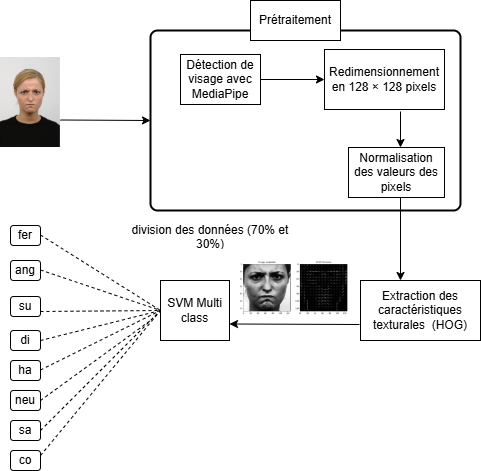

La méthodologie adoptée se décline en trois étapes : prétraitement des données via détection et redimensionnement des visages avec MediaPipe, extraction de caractéristiques en utilisant le descripteur HOG, et classification à l’aide d’un modèle SVM (Support Vector Machine). Ce modèle a été entraîné sur 70 % des données, les 30 % restantes étant utilisées pour les tests.

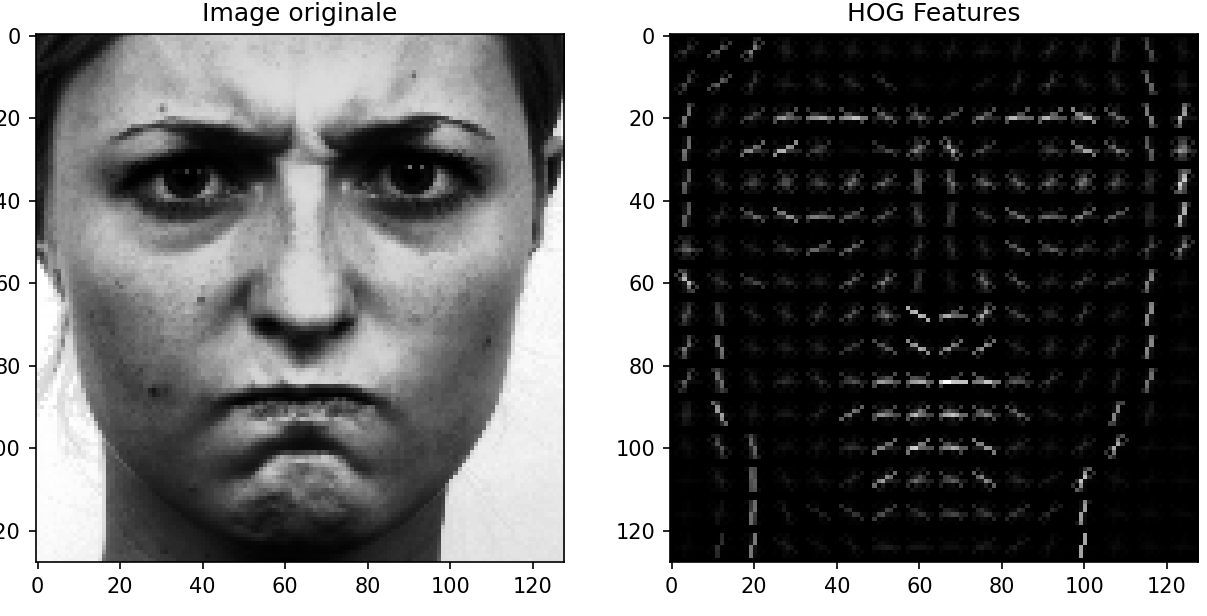

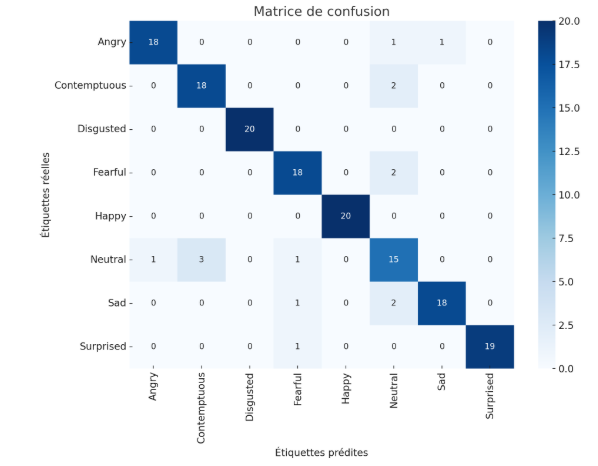

Résultats :

Les résultats obtenus sont très prometteurs : le modèle SVM atteint une précision, un rappel, un F1-score et une exactitude de 0.91, démontrant son efficacité et sa robustesse. Ces performances stables suggèrent une bonne adaptabilité à d’autres contextes.

Conclusion :

Les solutions techniques retenues offrent un bon compromis entre performance et simplicité de mise en œuvre. Des améliorations futures incluraient l’intégration de modèles plus complexes comme les réseaux de neurones profonds, ainsi que l’adaptation en temps réel à des vidéos ou des flux de caméras.

Présenté par

Yaye Dieynaba Fall, Maitrise informatique Levis, volet Recherche